Théorème Considérons l’équation $\dot{\boldsymbol{x}}=\boldsymbol{f}(\boldsymbol{x})$ et un point $\boldsymbol{x}_0$. Supposons que $\boldsymbol{f}$ soit différentiable et que toutes ses dérivées partielles, à savoir les fonctions $\frac{\partial f}{\partial x}$, $\frac{\partial f}{\partial y}$, $\frac{\partial g}{\partial x}$ et $\frac{\partial g}{\partial x}$, soient des fonctions continues de $\boldsymbol{x}$. Alors il existe un intervalle de temps $(-\tau,\tau)$ autour de $t=0$, avec $\tau>0$, tel que l’équation a une solution unique $\boldsymbol{x}(t)$ telle que $\boldsymbol{x}(0)=\boldsymbol{x}_0$.

En bref, l’existence et l’unicité des solutions sont garanties si $\boldsymbol{f}$ est continûment différentiable. La preuve de ce théorème est la même qu’en dimension un et elle est aussi la même en dimension supérieure ! A partir de maintenant, tous nos champs de vecteurs sont suffisamment réguliers pour que le théorème ci-dessus s’applique. Dans la plupart des exemples, en effet, les champs de vecteurs seront typiquement des fonctions polynomiales dans les variables $x,y$, ou parfois des fonctions rationnelles avec un dénominateur non-vanissant.

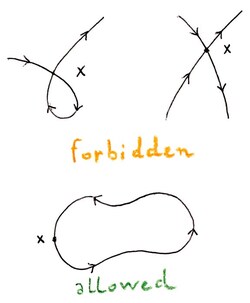

Ce théorème a un corollaire important : des trajectoires différentes ne se croisent jamais. Si deux trajectoires se croisaient, il y aurait alors deux solutions partant du même point (le point de croisement), ce qui violerait l’unicité garantie par le théorème. Par conséquent, les trajectoires partitionnent le plan $xy$. En particulier, s’il existe un point fixe $\bar{\boldsymbol{x}}$ (signifiant que $\boldsymbol{f}(\boldsymbol{x})=\boldsymbol{0}$), et si on peut l’atteindre, le temps qu’il faut est infini (si on ne part pas de ce point, bien sûr).

Pour exactement la même raison que celle expliquée en dimension un, il n’y a aucune perte de généralité à considérer $\boldsymbol{x}(0)=\boldsymbol{x}_0$ au temps $t=0$ car le champ de vecteurs ne dépend pas du temps. En dimension un, nous avons vu un exemple simple montrant qu’en général, les solutions n’existent pas pour tous les temps. Ce n’est pas une question simple mais, heureusement, pour toutes les applications que nous verrons, les solutions existent pour tous les temps.

Pour les systèmes à deux dimensions (par opposition aux systèmes à plus haute dimension), la partie du théorème ci-dessus garantissant l’unicité des solutions a de fortes conséquences topologiques que nous explorerons plus tard. Par exemple, supposons qu’il existe une trajectoire fermée $C$ dans le plan $xy$, qui correspond à une solution périodique. (Nous avons déjà rencontré des exemples de telles solutions dans la première partie.) Alors toute trajectoire tracée par une solution commençant en un point à l’intérieur de $C$ y est piégée pour toujours. Quel est le sort d’une telle solution bornée ? Nous allons voir que nous pouvons répondre à cette question grâce au théorème de Poincaré-Bendixson.